阿里云百煉上線Qwen2.5-Turbo模型:支持100萬超長上下文

快科技11月20日消息,阿里云百煉宣布,最新的Qwen2.5-Turbo模型已在平臺上線,即日起所有用戶可在阿里云百煉調用Qwen2.5-Turbo API,百萬tokens僅需0.3元,同時還免費為用戶贈送1000萬tokens額度。

該模型支持100萬超長上下文,相當于100萬個英文單詞或150萬個漢字,并且在多個長文本評測集中的性能表現超越GPT-4。

據介紹,Qwen2.5-Turbo可應用于長篇小說深入理解、倉庫級別代碼助手、多篇論文閱讀等場景,可一次性處理10本長篇小說,150小時的演講稿,3萬行代碼。

具體來看,Qwen2.5-Turbo在1M長度的超長文本檢索(Passkey Retrieval)任務中的準確率可達到100%,在長文本評測集RULER上獲得93.1分,超越GPT-4。

在LV-Eval、LongBench-Chat等更加接近真實場景的長文本任務中,Qwen2.5-Turbo在多數維度超越了GPT-4o-mini。

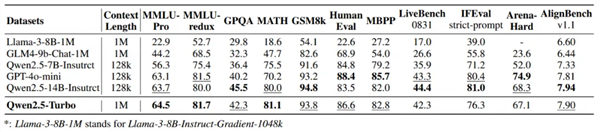

不僅是長文本,在MMU、LiveBench等短文本基準上Qwen2.5-Turbo的表現也非常優秀,在大部分任務上的表現顯著超越之前上下文長度為1M tokens的開源模型。

在推理速度方面,團隊利用稀疏注意力機制將注意力部分的計算量壓縮了約12.5倍,將處理1M tokens上下文時的首字返回時間從4.9分鐘降低到68秒,速度大幅提升了4.3倍。

不過通義千問團隊也表示,長文本任務處理依然存在諸多挑戰,未來將進一步探索長序列人類偏好對齊,優化推理效率以減少運算時間,并繼續研發更大、更強的長文本模型。

本站所有文章、數據、圖片均來自互聯網,一切版權均歸源網站或源作者所有。

如果侵犯了你的權益請來信告知我們刪除。郵箱:business@qudong.com